Occhioni da cucciolo, testa inclinata, sopracciglia alzate: sono espressioni che ci fanno amare i cani. Alcuni ricercatori inglesi hanno scoperto che i lupi non hanno i muscoli per sollevare le sopracciglia e allargare gli occhi. I cani, invece, li hanno ben sviluppati e li usano quando hanno un umano davanti a loro, per assumere “un’espressione affettuosa”.

Nel corso dei millenni, abbiamo “selezionato” proprio le specie di cani con queste caratteristiche, perché ci rendono facile stabilire un rapporto con loro. Secondo gli esperti, infatti, abbiamo una predisposizione innata, inconsapevole, a reagire con atteggiamenti di tenerezza a certe espressioni.

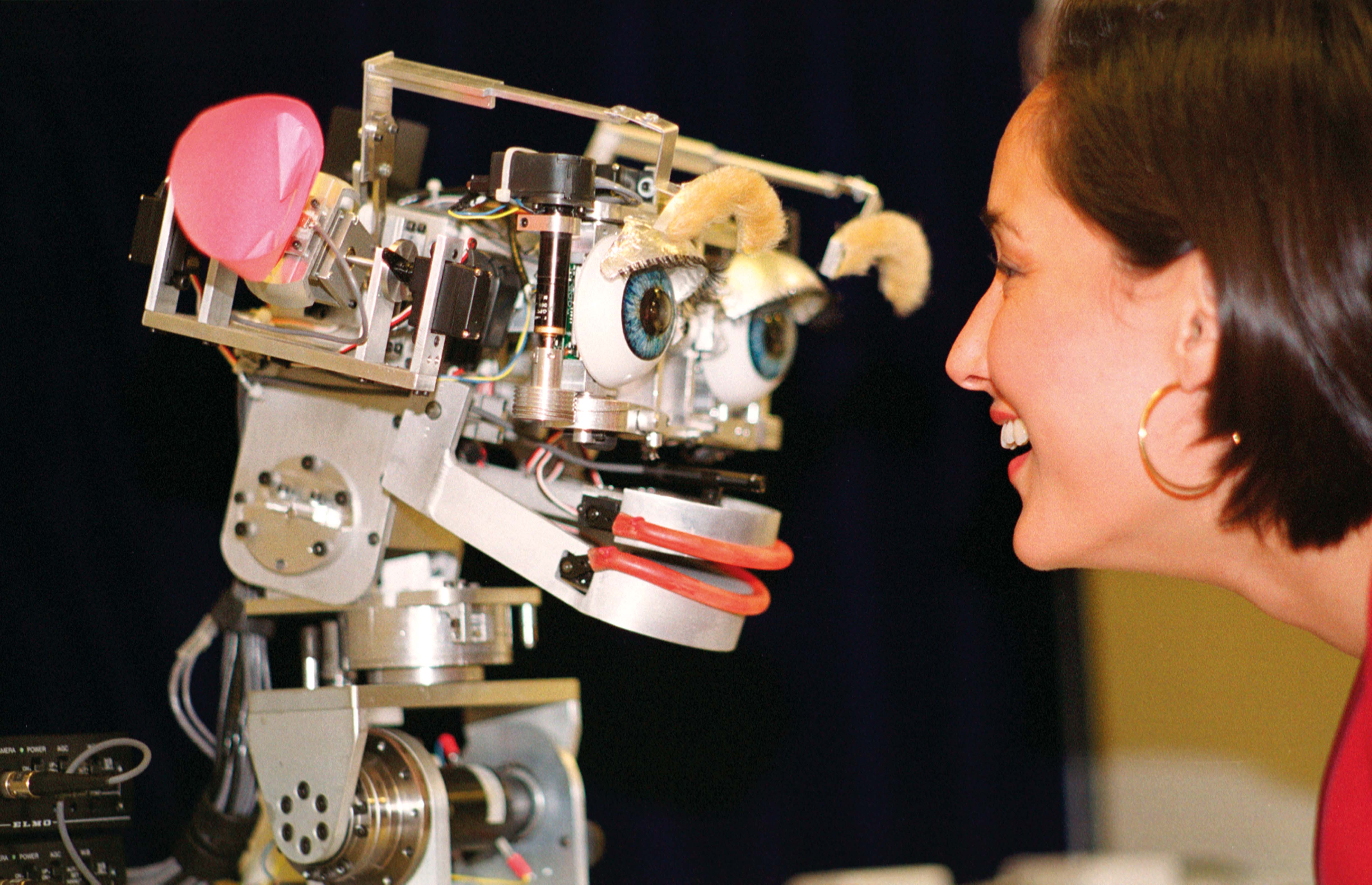

Questi risultati sono alla base di una branca particolare dell’Intelligenza artificiale (IA) che si occupa di “robot sociali”, automi capaci cioè di inserirsi nella nostra vita di umani, interagendo con noi con naturalezza. I robot non hanno autocoscienza, non capiscono quello che fanno, ma è comunque possibile costruire robot “indipendenti”, capaci di riconoscere le situazioni in cui si muovono, reagendo ad esse in modo non predeterminato dal programmatore. Agenti robotici, cioè, capaci di rivolgere la propria attenzione agli altri, in modo simile a come farebbe un cane in presenza di un umano. Robot dotati di un livello minimo di “autonomia sociale”, capaci di «modificare “di testa propria”, entro certi limiti, le regole che ne gestiscono le interazioni sociali» (Dumouchel, Damiano, Vivere con i robot, Raffaello Cortina 2019).

L’obiettivo è integrare questi robot autonomi nella normale comunicazione tra umani, con scambi affettivi elementari. Ci sono già alcuni esperimenti, limitati ma significativi. Paro è un “robot terapeutico”, utilizzato in ospedali e case di riposo. Assomiglia a un cucciolo di foca ed è autonomo: quando qualcuno lo chiama, reagisce alla voce voltando la testa. Quando invece viene accarezzato, muove coda e pinne, come se provasse piacere. Non fa altro. Eppure, con queste semplici reazioni riesce ad istaurare un rapporto “affettivo” con anziani e bambini, come farebbe un animale domestico. Reagisce al proprio nome, per cui stimola le persone a prenderlo in braccio e affezionarsi. Sembra interessato a colui che lo tiene in braccio, proprio quello di cui hanno bisogno le persone con deficit cognitivi.

Kaspar, invece, è un “robot compagno di giochi”, manovrato a distanza da un operatore umano nascosto. Viene utilizzato per «incoraggiare i bambini autistici all’interazione con gli altri», stimolandoli ad esprimere le proprie emozioni, a giocare rispettando i ruoli, a cooperare. Ha le dimensioni di un bambino di 3 anni, è abbastanza prevedibile e volutamente non molto realistico: questo fa sì che il bambino autistico sia rassicurato e non si vergogni davanti a Kaspar per le proprie incapacità, come farebbe con un infermiere umano.

Due esempi diversi, che fanno intravedere come «le emozioni e l’empatia artificiali, nelle interazioni tra robot e umani», possano generare una dinamica affettiva, attivando le stesse risposte che provoca un cucciolo di cane. Ci stiamo addentrando in regioni inesplorate, non solo dei robot, ma anche di noi stessi, che richiedono una riflessione etica (vedi box). Studiando come far funzionare questi robot, scopriamo infatti meglio come funzionano le nostre dinamiche sociali.

La “paura delle macchine” ci porterebbe a costruire robot che obbediscono a rigide regole morali (questo si può fare, quest’altro no), codificate da pochi costruttori che concentrano molto potere nelle proprie mani. Se invece consideriamo i robot come possibili “compagni di vita sociale”, dovremmo lasciar loro un certo margine di manovra (e di errore), un po’ di imprevedibilità, una minima “personalità” propria. In pratica, dovremmo realizzare «agenti robotici dotati di “competenze affettive” atte a facilitarne le interazioni sociali con gli umani». In questo modo inizierà una “co-evoluzione”. Si svilupperà cioè una nuova società, composta da 3 protagonisti: animali, robot e umani.

———–

Un codice etico per i robot

L’argomento è “caldo”, tanto che negli ultimi mesi sono uscite “linee guida per lo sviluppo dell’IA”, prodotte da Ue, Ocse e Nato. L’obiettivo è inserire dentro i robot, già in sede di ideazione e progettazione, il rispetto delle leggi e dei valori sanciti dal diritto internazionale in materia di diritti umani. L’IA deve anche minimizzare i danni non intenzionali. Gli stessi dirigenti delle aziende che lavorano sull’IA si interrogano e chiedono aiuto a filosofi e teologi, perché si rendono conto che questa nuova tecnologia avrà un impatto straordinario sulla società.