CN+

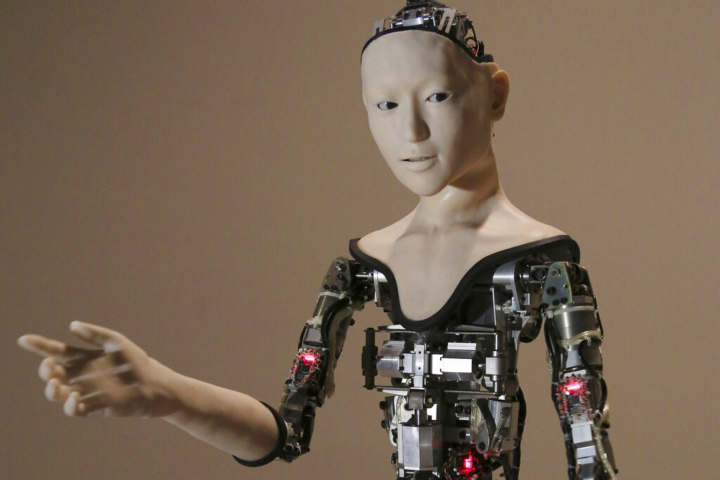

Intelligenza Artificiale e persona umana

Istituito per la prima volta in Italia un dottorato in Intelligenza Artificiale (IA) con caratteristiche di eccellenza a livello mondiale. Un investimento notevole per supportare la formazione e la ricerca su un tema-chiave del prossimo futuro e per guidare la transizione digitale del Paese.

Cinque atenei capofila, coinvolti sinergicamente per cinque aree strategiche di ricerca: Salute e scienze della vita (Università Campus Bio-Medico di Roma); Agricoltura e ambiente (Università degli Studi di Napoli Federico II); Sicurezza e cybersecurity (Sapienza Università di Roma); Industria 4.0…

QUESTO CONTENUTO È RISERVATO AGLI ABBONATI A CN+

Per visualizzarlo effettua il login